Anthropic ادعا می کند که مدل های جدید آن GPT-4 را شکست داده اند

استارتاپ هوش مصنوعی Anthropic، با حمایت صدها میلیون سرمایه خطرپذیر (و شاید به زودی صدها میلیون نفر دیگر)، امروز آخرین نسخه فناوری GenAI خود، Claude را معرفی کرد. و این شرکت ادعا می کند که از نظر عملکرد با GPT-4 OpenAI رقابت می کند.

Claude 3، همانطور که GenAI جدید Anthropic نامیده می شود، خانواده ای از مدل ها است - Claude 3 Haiku، Claude 3 Sonnet و Claude 3 Opus، که Opus قدرتمندترین آنه است. همه «قابلیتهای افزایشیافته» در تحلیل و پیشبینی، ادعاهای Anthropic، و همچنین عملکرد بهبود یافته در معیارهای خاص در مقابل مدلهایی مانند GPT-4 (اما نه GPT-4 Turbo) و Gemini 1.0 Ultra Google (اما نه Gemini 1.5 Pro) را نشان میدهند.

شایان ذکر است، Claude 3 اولین GenAI چندوجهی Anthropic است، به این معنی که می تواند متن و همچنین تصاویر را تجزیه و تحلیل کند - شبیه به برخی از طعم های GPT-4 و Gemini. Claude 3 میتواند عکسها، نمودارها، نمودارها و نمودارهای فنی، طراحی از فایلهای PDF، نمایش اسلاید و سایر انواع سند را پردازش کند.

در مرحله اول بهتر از برخی از رقبای GenAI، Claude 3 می تواند چندین تصویر را در یک درخواست (حداکثر 20) تجزیه و تحلیل کند. Anthropic اشاره می کند که این به آن اجازه می دهد تصاویر را مقایسه و کنتراست کند.

اما برای پردازش تصویر کلود 3 محدودیت هایی وجود دارد.

آنتروپیک مدل ها را از شناسایی افراد ناتوان کرده است - بدون شک نسبت به پیامدهای اخلاقی و قانونی محتاط است. و این شرکت اعتراف می کند که کلود 3 مستعد اشتباه کردن با تصاویر با کیفیت پایین (زیر 200 پیکسل) است و با کارهایی که شامل استدلال فضایی (مثلاً خواندن صفحه ساعت آنالوگ) و شمارش اشیا است (کلود 3 نمی تواند دقیق ارائه دهد) مبارزه می کند. تعداد اشیاء در تصاویر).

اعتبار تصویر: Anthropic

کلود 3 نیز اثر هنری تولید نخواهد کرد. مدلها به شدت در حال تجزیه و تحلیل تصویر هستند - حداقل در حال حاضر.

آنتروپیک او میگوید که مشتریان عموماً میتوانند از Claude 3 انتظار داشته باشند که دستورالعملهای چند مرحلهای را بهتر دنبال کند، خروجی ساختاریافته در قالبهایی مانند JSON تولید کند و به زبانهایی غیر از انگلیسی در مقایسه با نسخههای قبلی خود مکالمه کند. آنتروپیک او میگوید ، کلود 3 همچنین به دلیل «درک دقیقتر درخواستها» باید کمتر به سؤالات پاسخ دهد. و به زودی، Claude 3 منبع پاسخ های خود را به سؤالات ذکر می کند تا کاربران بتوانند آنها را تأیید کنند.

آنتروپیک در مقاله ای پشتیبانی می نویسد: «کلود 3 تمایل دارد پاسخ های گویاتر و جذاب تری ایجاد کند. «[این] در مقایسه با مدلهای قدیمی ما، راهنمایی و هدایت آن آسانتر است. کاربران باید دریابند که میتوانند با اعلانهای کوتاهتر و مختصرتر به نتایج دلخواه برسند.»

برخی از این پیشرفتها از بستر گسترده کلود 3 ناشی میشوند.

زمینه مدل یا پنجره زمینه به داده های ورودی (مثلا متن) اشاره دارد که مدل قبل از تولید خروجی در نظر می گیرد. مدلهایی با پنجرههای زمینهای کوچک تمایل دارند محتوای مکالمات بسیار اخیر را فراموش کنند، و آنها را به دور شدن از موضوع سوق میدهد - اغلب به روشهای مشکلساز. به عنوان یک نکته مثبت، مدلهای با زمینه بزرگ میتوانند جریان روایت دادههایی را که دریافت میکنند بهتر درک کنند و پاسخهای غنیتری از نظر محتوایی (حداقل فرضی) ایجاد کنند.

Anthropic می گوید که Claude 3 در ابتدا از یک پنجره زمینه 200,000 رمزی، معادل حدود 150,000 کلمه پشتیبانی می کند و مشتریان منتخب یک پنجره زمینه 1 میلیون توکن (700,000 کلمه) را دریافت می کنند. این همتراز با جدیدترین مدل GenAI گوگل، Gemini 1.5 Pro فوق الذکر است، که همچنین یک پنجره با زمینه 1 میلیونی را ارائه می دهد.

در حال حاضر، فقط به این دلیل که کلود 3 نسبت به نسخه قبلی ارتقا یافته است، به این معنی نیست که کامل است.

در یک مقاله فنی، Anthropic اعتراف میکند که کلود 3 از مسائلی که سایر مدلهای GenAI را گرفتار میکند، یعنی سوگیری و توهم (یعنی ساختن چیزها) مصون نیست. برخلاف برخی از مدلهای GenAI، Claude 3 نمیتواند در وب جستجو کند. مدلها فقط میتوانند با استفاده از دادههای قبل از آگوست 2023 به سؤالات پاسخ دهند. و در حالی که کلود چند زبانه است، به برخی از زبانهای «کم منبع» در مقایسه با انگلیسی آنقدر مسلط نیست.

اما Anthropic بهروزرسانیهای مکرر Claude 3 را در ماههای آینده بهروزرسانی میکند.

این شرکت در یک پست وبلاگی مینویسد: «ما معتقد نیستیم که هوشمندی مدل نزدیک به محدودیتهای خود باشد، و قصد داریم در چند ماه آینده [پیشرفتهای] را برای خانواده مدل کلود 3 عرضه کنیم».

Opus و Sonnet اکنون در وب و از طریق کنسول توسعه دهنده Anthropic و API، پلتفرم Bedrock آمازون و Vertex AI گوگل در دسترس هستند. هایکو اواخر امسال دنبال خواهد شد.

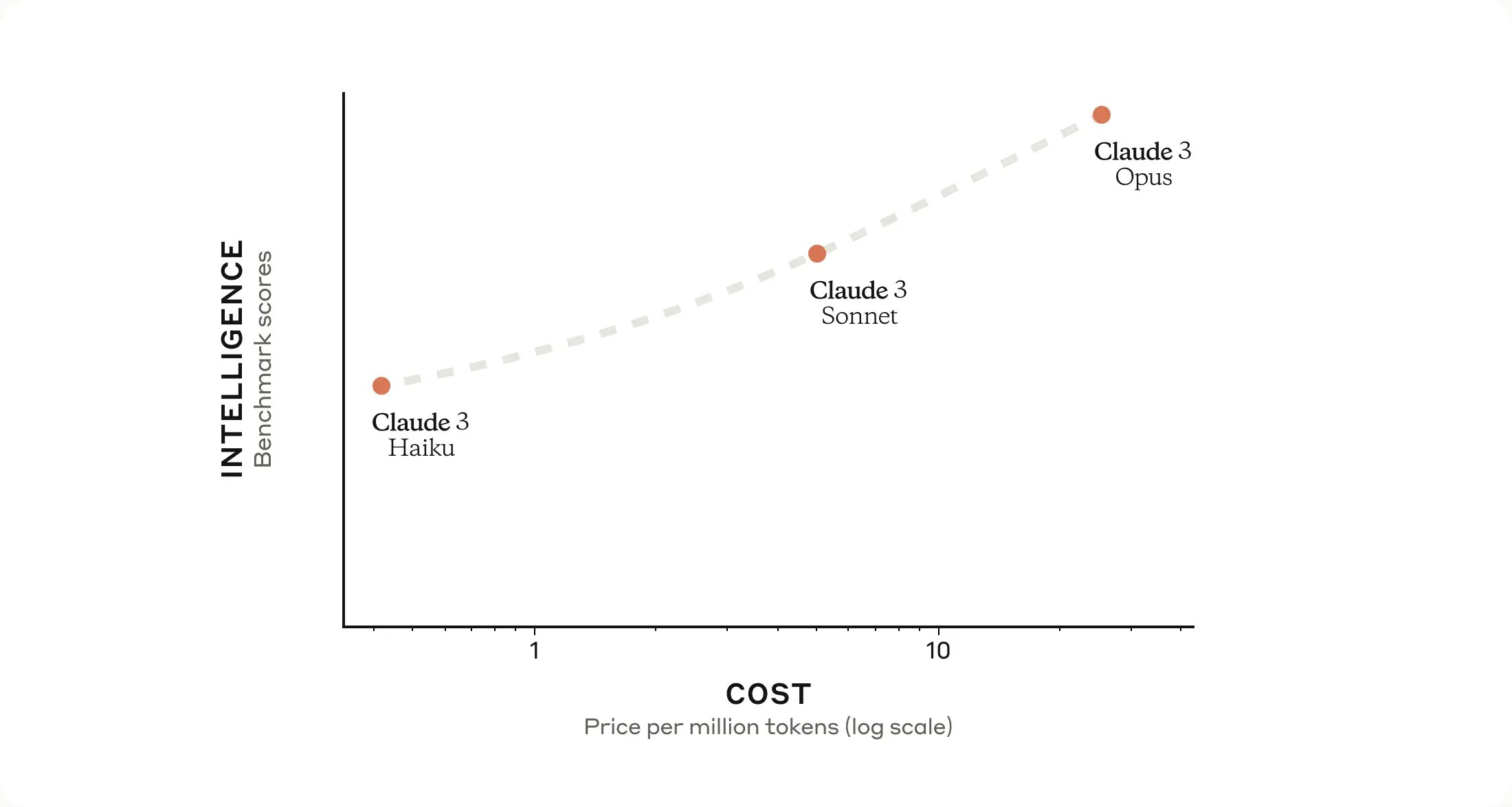

در اینجا تفکیک قیمت ها آمده است:

Opus: 15 دلار در هر میلیون توکن ورودی، 75 دلار در هر میلیون توکن خروجی

غزل: 3 دلار در هر میلیون توکن ورودی، 15 دلار در هر میلیون توکن خروجی

هایکو: 0.25 دلار به ازای هر میلیون توکن ورودی، 1.25 دلار به ازای هر میلیون توکن خروجی

پس این کلود 3 است. اما منظره 30000 فوتی چیست؟

خوب، همانطور که قبلاً گزارش دادیم، جاه طلبی آنتروپیک ایجاد یک «الگوریتم نسل بعدی برای خودآموزی هوش مصنوعی» است. چنین الگوریتمی میتواند برای ساخت دستیارهای مجازی استفاده شود که میتوانند به ایمیلها پاسخ دهند، تحقیقات انجام دهند و آثار هنری، کتابها و موارد دیگر تولید کنند - که قبلاً با نمونههایی مانند GPT-4 و سایر مدلهای زبان بزرگ طعم برخی از آنها را چشیدهایم .

Anthropic در پست وبلاگ فوق به این موضوع اشاره می کند و می گوید که قصد دارد ویژگی هایی را به Claude 3 اضافه کند که قابلیت های خارج از دروازه آن را با اجازه دادن به Claude برای تعامل با سایر سیستم ها، کدگذاری "تعاملی" و ارائه "قابلیت های عامل پیشرفته" افزایش می دهد. "

آخرین نکته جاه طلبی های گزارش شده OpenAI برای ایجاد یک عامل نرم افزاری برای خودکارسازی وظایف پیچیده مانند انتقال داده ها از یک سند به صفحه گسترده یا پر کردن خودکار گزارش های هزینه و وارد کردن آنها در نرم افزار حسابداری را به یاد می آورد. OpenAI قبلاً یک API ارائه میدهد که به توسعهدهندگان اجازه میدهد تا «تجربههای عاملمانند» را در برنامههای خود ایجاد کنند، و به نظر میرسد Anthropic قصد دارد عملکردهایی را ارائه دهد که قابل مقایسه است.

آیا میتوانیم در مرحله بعد یک تولیدکننده تصویر از Anthropic ببینیم؟ رک و پوست کنده من را شگفت زده می کند. تولیدکنندههای تصویر این روزها موضوع بحثهای فراوانی هستند، عمدتاً به دلایل مربوط به حق چاپ و تعصب. گوگل اخیراً پس از تزریق تنوع به تصاویر با بیتوجهی مسخره به بافت تاریخی، مجبور شد مولد تصویر خود را غیرفعال کند. و تعدادی از فروشندگان تولید کننده تصویر با هنرمندانی که آنها را به سود بردن از کار خود با آموزش GenAI در مورد آن کار بدون ارائه غرامت یا حتی اعتبار متهم می کنند، درگیر نبردهای قانونی هستند.

من کنجکاو هستم که تکامل تکنیک Anthropic را برای آموزش GenAI، "هوش مصنوعی قانونی" ببینم، که این شرکت ادعا میکند که رفتار GenAI خود را برای درک آسانتر، قابل پیشبینیتر و تنظیم آن در صورت نیاز سادهتر میکند. هدف از هوش مصنوعی Constitutional ارائه راهی برای همسو کردن هوش مصنوعی با نیات انسان است، مدل هایی که به سؤالات پاسخ می دهند و وظایف را با استفاده از مجموعه ای ساده از اصول راهنما انجام می دهند. به عنوان مثال، برای کلود 3، آنتروپیک بيان کرد که این اصل را اضافه کرده است - که با بازخورد جمعسپاری شده است - که به مدلها دستور میدهد تا افراد دارای معلولیت را درک کنند و در دسترس باشند.

پایان بازی Anthropic هر چه باشد، برای مدت طولانی در آن حضور دارد. طبق گزارشی که در ماه مه سال گذشته فاش شد، این شرکت قصد دارد تا 5 میلیارد دلار در 12 ماه آینده یا بیشتر جمع آوری کند - که ممکن است تنها پایه ای باشد که برای رقابت با OpenAI نیاز دارد. (به هر حال، مدلهای آموزشی ارزان نیستند.) با 2 میلیارد و 4 میلیارد دلار سرمایه متعهد و تعهدات گوگل و آمازون به ترتیب، و مجموعاً بیش از یک میلیارد از دیگر حامیان، در راه است.

ارسال نظر