این هفته در هوش مصنوعی: آیا خریداران واقعاً GenAI آمازون را می خواهند؟

همگام شدن با صنعتی که به سرعت هوش مصنوعی در حال حرکت است، امری دشوار است. پس تا زمانی که یک هوش مصنوعی بتواند این کار را برای شما انجام دهد، در اینجا خلاصهای مفید از داستانهای اخیر در دنیای یادگیری ماشین، همراه با تحقیقات و آزمایشهای قابلتوجهی است که به تنهایی پوشش ندادهایم.

این هفته، آمازون Rufus را معرفی کرد، یک دستیار خرید مجهز به هوش مصنوعی که در کاتالوگ محصولات غول تجارت الکترونیک و همچنین اطلاعاتی از سراسر وب آموزش دیده است. روفوس در اپلیکیشن موبایل آمازون زندگی می کند و به یافتن محصولات، انجام مقایسه محصولات و دریافت توصیه هایی در مورد خرید کمک می کند.

از تحقیقات گسترده در شروع یک سفر خرید مانند "در هنگام خرید کفش دویدن به چه نکاتی توجه کنیم؟" به مقایسه هایی مانند "تفاوت های بین کفش های دویدن تریل و جاده ای چیست؟" آمازون در یک پست وبلاگ می نویسد ... Rufus به طور معنی داری بهبود می بخشد که مشتریان چقدر راحت می توانند بهترین محصولات را برای رفع نیازهای خود پیدا کنند و کشف کنند.

این همه عالی است. اما سوال من این است که واقعا چه کسی برای آن فریاد می زند؟

من متقاعد نیستم که GenAI، به ویژه در قالب چت بات، یک تکه فناوری است که افراد عادی به آن اهمیت می دهند - یا حتی به آن فکر می کنند. نظرسنجی ها از من در این امر حمایت می کنند. در آگوست گذشته، مرکز تحقیقات پیو دریافت که در میان کسانی که در ایالات متحده درباره چت ربات GenAI OpenAI ChatGPT شنیده اند (18٪ از بزرگسالان)، تنها 26٪ آن را امتحان کرده اند. البته میزان استفاده بر اساس سن متفاوت است و درصد بیشتری از جوانان (زیر 50 سال) نسبت به افراد مسن گزارش داده اند که از آن استفاده کرده اند. اما واقعیت این است که اکثریت قریب به اتفاق نمیدانند – یا اهمیتی نمیدهند – از چیزی که مسلماً محبوبترین محصول GenAI است استفاده کنند.

GenAI مشکلات خود را دارد که به خوبی تبلیغ شده است، از جمله تمایل به ساختن حقایق، نقض حق چاپ و سوگیری و سمی بودن. تلاش قبلی آمازون در یک ربات چت GenAI، آمازون Q، به شدت با مشکل مواجه شد - اطلاعات محرمانه را در اولین روز انتشار آن فاش کرد. اما من می توانم استدلال کنم که بزرگترین مشکل GenAI در حال حاضر - حداقل از نقطه نظر مصرف کننده - این است که چند دلیل جهانی قانع کننده برای استفاده از آن وجود دارد.

مطمئناً، GenAI مانند Rufus میتواند در انجام کارهای خاص و باریک مانند خرید به مناسبت (مثلا پیدا کردن لباس برای زمستان)، مقایسه دستهبندی محصولات (مانند تفاوت بین برق لب و روغن) و ارائه توصیههای برتر (مثلا هدایای روز ولنتاین) کمک کند. با این حال، آیا این نیازهای اکثر خریداران را برطرف می کند؟ نه بر اساس نظرسنجی اخیر استارتاپ نرم افزار تجارت الکترونیک Namogoo.

Namogoo که از صدها مشتری در مورد نیازها و ناامیدی آنها در مورد خرید آنلاین سؤال کرد، دریافت که تصاویر محصول تا حد زیادی مهمترین عامل ایجاد یک تجربه خوب در تجارت الکترونیک بوده و پس از آن تحلیل ها و توضیحات محصول ارائه می شود. پاسخ دهندگان جستجو را به عنوان چهارمین مهم ترین و "ناوبری ساده" را در رتبه پنجم قرار دادند. به خاطر سپردن ترجیحات، اطلاعات و تاریخچه خرید در رتبه دوم قرار داشت.

مفهوم این است که مردم معمولاً با یک محصول خرید می کنند. که جستجو یک فکر بعدی است. شاید روفوس معادله را به هم بزند. من تمایل دارم که فکر نکنم، به خصوص اگر این یک راهاندازی دشوار باشد (و ممکن است با استقبال دیگر آزمایشهای خرید آمازون GenAI مواجه شود) - اما فکر میکنم اتفاقات عجیبتری رخ داده است.

در اینجا برخی دیگر از داستان های هوش مصنوعی قابل توجه در چند روز گذشته آورده شده است:

آزمایشهای Google Maps با GenAI : Google Maps یک ویژگی GenAI را برای کمک به شما در کشف مکانهای جدید معرفی میکند. این ویژگی با استفاده از مدلهای زبان بزرگ (LLM) بیش از 250 میلیون مکان را در Google Maps و مشارکت بیش از 300 میلیون راهنمای محلی را تجزیه و تحلیل میکند تا پیشنهاداتی را بر اساس آنچه به دنبال آن هستید ارائه دهد.

ابزارهای GenAI برای موسیقی و موارد دیگر: در اخبار دیگر گوگل، غول فناوری ابزارهای GenAI را برای ایجاد موسیقی، اشعار و تصاویر منتشر کرد و Gemini Pro را، یکی از LLM های توانمندتر خود، برای کاربران چت ربات Bard خود در سراسر جهان آورد.

مدلهای جدید هوش مصنوعی باز: مؤسسه آلن برای هوش مصنوعی، مؤسسه تحقیقاتی غیرانتفاعی هوش مصنوعی که توسط بنیانگذار فقید مایکروسافت، پل آلن تأسیس شد، چندین مدل زبان GenAI را منتشر کرد که ادعا میکند نسبت به سایرین «بازتر» هستند - و مهمتر از همه، مجوز در چنین زمینهای دارند. روشی که توسعه دهندگان می توانند بدون محدودیت از آنها برای آموزش، آزمایش و حتی تجاری سازی استفاده کنند.

حرکت FCC برای ممنوع کردن تماسهای تولید شده توسط هوش مصنوعی: FCC پیشنهاد میکند که استفاده از فناوری شبیهسازی صوتی در تماسهای رباتیک اساساً غیرقانونی تلقی شود، و این امر باعث میشود هزینه اپراتورهای این کلاهبرداریها آسانتر شود.

Shopify ویرایشگر تصویر را عرضه می کند: Shopify یک ویرایشگر رسانه GenAI را برای بهبود تصاویر محصول منتشر می کند. بازرگانان می توانند یک نوع از هفت سبک را انتخاب کنند یا یک اعلان برای ایجاد یک پس زمینه جدید تایپ کنند.

GPTها، فراخوانی شده: OpenAI با فعال کردن کاربران ChatGPT برای فراخوانی آنها در هر چت، به پذیرش GPTها، برنامه های شخص ثالثی که توسط مدل های هوش مصنوعی آن قدرت می گیرند، فشار می آورد. کاربران پولی ChatGPT میتوانند با تایپ «@» و انتخاب یک GPT از فهرست، GPTها را وارد مکالمه کنند.

OpenAI با Common Sense شریک میشود: OpenAI در یک اعلامیه غیرمرتبط بيان کرد که با Common Sense Media، سازمان غیرانتفاعی که مناسب بودن رسانهها و فناوریهای مختلف را برای کودکان تحلیل و رتبهبندی میکند، برای همکاری در دستورالعملهای هوش مصنوعی و مواد آموزشی برای والدین، همکاری میکند. مربیان و جوانان.

ایوان می نویسد : مرورگر مستقل: شرکت مرورگر که مرورگر Arc را می سازد، در تلاش است تا یک هوش مصنوعی بسازد که برای شما در وب گشت و گذار کند و در حالی که موتورهای جستجو را دور می زند، نتایج را برای شما به ارمغان می آورد.

یادگیری ماشینی بیشتر

آیا یک هوش مصنوعی میداند که برای یک موقعیت، رسانه یا گفته معین چه چیزی «عادی» یا «معمولی» است؟ به نوعی، مدلهای زبان بزرگ بهطور منحصربهفردی برای شناسایی الگوهایی که بیشتر شبیه الگوهای دیگر در مجموعه دادههایشان هستند، مناسب هستند. و در واقع این همان چیزی است که محققان ییل در تحقیقات خود در مورد اینکه آیا یک هوش مصنوعی میتواند «معمول بودن» یک چیز را در گروهی از چیزهای دیگر تشخیص دهد، دریافتند. به عنوان مثال، با توجه به 100 رمان عاشقانه، با توجه به آنچه که مدل در مورد آن ژانر ذخیره کرده است، کدامیک بیشترین و کدام کمتر «معمولی» است؟

جالب است (و ناامیدکننده) که پروفسور Balázs Kovács و Gaël Le Mens سالها روی مدل خودشان، یک نوع BERT کار کردند، و درست زمانی که میخواستند منتشر کنند، ChatGPT منتشر شد و از بسیاری جهات دقیقاً همان کاری را که انجام میدادند تکرار کرد. لو منز در یک بیانیه خبری گفت: "شما می توانید گریه کنید." اما خبر خوب این است که هوش مصنوعی جدید و مدل قدیمی و تنظیمشده آنها هر دو نشان میدهند که در واقع، این نوع سیستم میتواند موارد معمولی و غیر معمول را در یک مجموعه داده شناسایی کند، یافتهای که میتواند در این مسیر مفید باشد. این دو به این نکته اشاره می کنند که اگرچه ChatGPT در عمل از تز آنها پشتیبانی می کند، ماهیت بسته آن کار علمی با آن را دشوار می کند.

دانشمندان دانشگاه پنسیلوانیا در حال تحلیل مفهوم عجیب دیگری برای تعیین کمیت بودند: عقل سلیم. با درخواست از هزاران نفر برای رتبهبندی عبارات، مواردی مانند «آنچه را که میدهید دریافت میکنید» یا «غذایی که تاریخ انقضای آن گذشته است نخورید» در مورد میزان «عرف عمومی» آنها. جای تعجب نیست، اگرچه الگوهایی پدیدار شدند، اما «باورهای کمی در سطح گروه به رسمیت شناخته شدند».

مارک وایتینگ، نویسنده همکار، او میگوید : «یافتههای ما نشان میدهد که ایده هر فرد از عقل سلیم ممکن است منحصر به فرد باشد و این مفهوم را کمتر از آنچه انتظار داریم که رایج کند». چرا این در خبرنامه هوش مصنوعی وجود دارد؟ از آنجا که تقریباً مانند هر چیز دیگری، معلوم میشود که چیزی به «ساده» بودن عقل سلیم، که ممکن است انتظار داشته باشیم هوش مصنوعی در نهایت داشته باشد، اصلاً ساده نیست! اما با کمی کردن آن از این طریق، محققان و حسابرسان ممکن است بتوانند بگویند یک هوش مصنوعی چقدر عقل سلیم دارد یا با چه گروهها و سوگیریهایی همسو میشود.

وقتی صحبت از تعصبات شد، بسیاری از مدلهای زبان بزرگ با اطلاعاتی که دریافت میکنند بسیار ضعیف هستند، به این معنی که اگر به آنها دستور درست بدهید، میتوانند به روشهایی توهینآمیز، نادرست یا هر دو پاسخ دهند. Latimer استارتاپی است که قصد دارد آن را با مدلی تغییر دهد که طراحی آن فراگیرتر باشد.

اگرچه جزئیات زیادی در مورد رویکرد آنها وجود ندارد، لاتیمر او میگوید که مدل آنها از Retrieval Augmented Generation (که برای بهبود پاسخها فکر میشود) و دستهای از محتواها و دادههای دارای مجوز منحصربهفرد استفاده میکند که از فرهنگهای زیادی که به طور معمول در این پایگاههای داده ارائه نمیشوند، منبع میشوند. پس وقتی در مورد چیزی میپرسید، مدل برای پاسخ به شما به تکنگاری قرن نوزدهمی برمیگردد. زمانی که Latimer اطلاعات بیشتری را منتشر کرد، در مورد مدل بیشتر خواهیم آموخت.

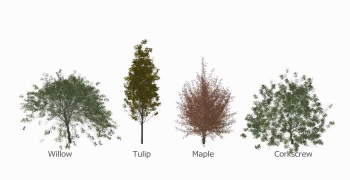

اعتبار تصویر: پوردو / بدریچ بنس

با این حال، یکی از کارهایی که یک مدل هوش مصنوعی می تواند انجام دهد، رشد درختان است. درختان جعلی محققان موسسه جنگلداری دیجیتال پوردو (جایی که میخواهم کار کنم، با من تماس بگیرید) یک مدل فوقالعاده فشرده ساختند که رشد یک درخت را به طور واقعی شبیهسازی میکند. این یکی از آن مشکلاتی است که ساده به نظر می رسد اما اینطور نیست. شما می توانید رشد درخت را شبیه سازی کنید که اگر در حال ساخت یک بازی یا فیلم باشید، مطمئناً کار می کند، اما در مورد کار علمی جدی چطور؟ بدریچ بنز، نویسنده اصلی این مقاله گفت: «اگرچه هوش مصنوعی به ظاهر فراگیر شده است، اما تاکنون در مدلسازی هندسههای سه بعدی غیرمرتبط با طبیعت بسیار موفق بوده است. »

مدل جدید آنها فقط یک مگابایت است که برای یک سیستم هوش مصنوعی بسیار کوچک است. البته DNA حتی کوچکتر و متراکم تر است و کل درخت را از ریشه تا جوانه رمزگذاری می کند. این مدل هنوز به صورت انتزاعی کار می کند - به هیچ وجه شبیه سازی کاملی از طبیعت نیست - اما نشان می دهد که پیچیدگی های رشد درخت را می توان در یک مدل نسبتا ساده کدگذاری کرد.

در آخر، روباتی از محققان دانشگاه کمبریج که می تواند خط بریل را سریعتر از انسان و با دقت 90 درصد بخواند. چرا می پرسی؟ در واقع، استفاده از آن برای افراد نابینا نیست - تیم تصمیم گرفت که این یک کار جالب و به راحتی قابل سنجش برای آزمایش حساسیت و سرعت نوک انگشتان روباتیک است. اگر فقط با زوم کردن روی آن می تواند خط بریل را بخواند، این نشانه خوبی است! در اینجا می توانید اطلاعات بیشتری در مورد این رویکرد جالب بخوانید. یا ویدئوی زیر را تماشا کنید:

ارسال نظر