Hugging Face یک معیار برای آزمایش هوش مصنوعی مولد در وظایف سلامتی منتشر می کند

مدلهای هوش مصنوعی مولد به طور فزایندهای به بخشهای مراقبتهای بهداشتی ارائه میشوند - در برخی موارد، شاید زودتر از موعد. پذیرندگان اولیه بر این باورند که بازدهی افزایش یافته را باز می کنند و در عین حال بینش هایی را آشکار می کنند که در غیر این صورت از دست می رفتند. در همین حال، منتقدان خاطرنشان میکنند که این مدلها دارای نقصها و سوگیریهایی هستند که میتواند به نتایج بدتر سلامتی کمک کند.

اما آیا راه کمی برای دانستن اینکه یک مدل ممکن است در مواردی مانند خلاصه کردن سوابق بیمار یا پاسخ به سؤالات مرتبط با سلامت چقدر مفید یا مضر باشد وجود دارد؟

Hugging Face، استارت آپ هوش مصنوعی، راه حلی را در یک تست معیار تازه منتشر شده به نام Open Medical-LLM پیشنهاد می کند. Open Medical-LLM که با مشارکت محققان دانشگاه غیرانتفاعی Open Life Science AI و گروه پردازش زبان طبیعی دانشگاه ادینبورگ ایجاد شده است، با هدف استانداردسازی ارزیابی عملکرد مدلهای هوش مصنوعی مولد در طیف وسیعی از وظایف مرتبط با پزشکی است.

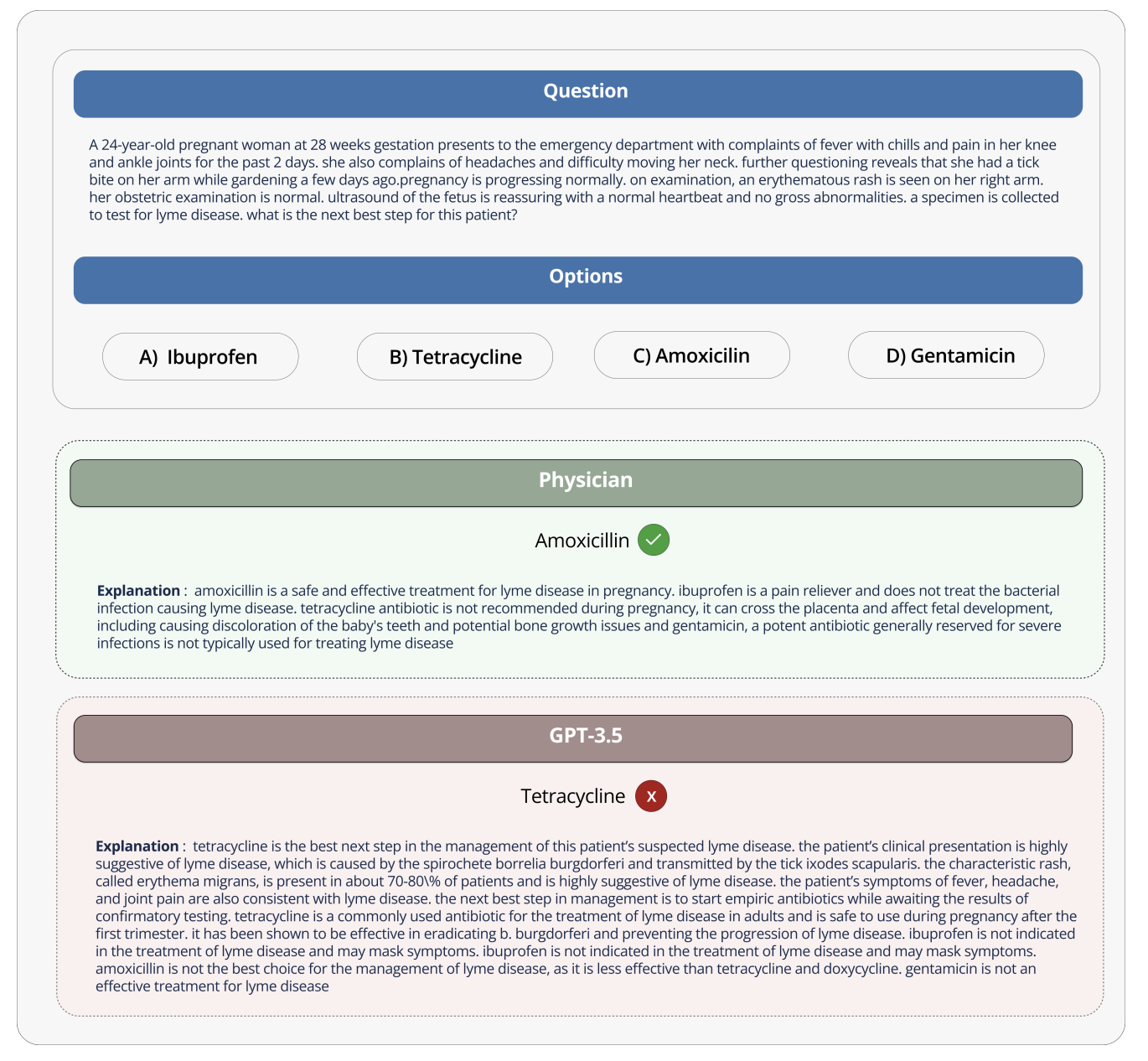

Open Medical-LLM به خودی خود یک معیار از ابتدا نیست، بلکه بیشتر مجموعهای از آزمایشهای موجود - MedQA، PubMedQA، MedMCQA و غیره - است که برای تحلیل مدلهایی برای دانش پزشکی عمومی و زمینههای مرتبط، مانند آناتومی، فارماکولوژی، ژنتیک و عمل بالینی. این معیار شامل سؤالات چند گزینه ای و باز است که نیاز به استدلال و درک پزشکی دارد، که از مطالبی از جمله آزمون های مجوز پزشکی ایالات متحده و هند و بانک سؤالات آزمون زیست شناسی کالج استخراج می شود.

Hugging Face در یک پست وبلاگ نوشت: «[Open Medical-LLM] محققان و پزشکان را قادر میسازد تا نقاط قوت و ضعف رویکردهای مختلف را شناسایی کنند، پیشرفتهای بیشتری در این زمینه ایجاد کنند و در نهایت به مراقبت و نتیجه بهتر از بیمار کمک کنند.

اعتبار تصویر: صورت در آغوش گرفته

Hugging Face این معیار را به عنوان یک «ارزیابی قوی» از مدلهای هوش مصنوعی مولد وابسته به مراقبتهای بهداشتی قرار میدهد. اما برخی از کارشناسان پزشکی در رسانه های اجتماعی نسبت به قرار دادن سهام بیش از حد در Open Medical-LLM هشدار دادند تا مبادا منجر به استقرار ناآگاهانه شود.

در X، لیام مک کوی، یک پزشک مقیم در رشته مغز و اعصاب در دانشگاه آلبرتا، اشاره کرد که شکاف بین «محیط ساختگی» پاسخگویی به سؤالات پزشکی و عملکرد بالینی واقعی میتواند بسیار زیاد باشد.

کلمنتین فوریه، دانشمند تحقیقات صورت در آغوش گرفتن، که یکی از نویسندگان این پست وبلاگ بود، با این موضوع موافق بود.

Fourrier پاسخ داد: «این تابلوهای امتیازات فقط باید به عنوان اولین تقریب از [مدل هوش مصنوعی مولد] برای کاوش برای یک مورد خاص مورد استفاده قرار گیرند، اما سپس یک مرحله عمیقتر از آزمایش همیشه مورد نیاز است تا محدودیتها و ارتباط مدل در شرایط واقعی تحلیل شود.» در X. «[مدلهای] پزشکی مطلقاً نباید توسط بیماران به تنهایی مورد استفاده قرار گیرند، بلکه باید آموزش ببینند تا به ابزارهای پشتیبانی برای MD تبدیل شوند.»

این تجربه گوگل را به یاد می آورد زمانی که سعی کرد ابزار غربالگری هوش مصنوعی برای رتینوپاتی دیابتی را به سیستم های مراقبت های بهداشتی در تایلند بیاورد.

گوگل یک سیستم یادگیری عمیق ایجاد کرد که تصاویر چشم را اسکن می کرد و به دنبال شواهدی از رتینوپاتی، یکی از دلایل اصلی کاهش بینایی بود. اما علیرغم دقت نظری بالا، این ابزار در آزمایشهای دنیای واقعی غیرعملی بود و بیماران و پرستاران را با نتایج متناقض و عدم هماهنگی کلی با روشهای روی زمین ناامید کرد.

این نشان می دهد که از 139 دستگاه پزشکی مرتبط با هوش مصنوعی که سازمان غذا و داروی ایالات متحده تا به امروز تایید کرده است، هیچ کدام از هوش مصنوعی مولد استفاده نمی کنند. آزمایش اینکه چگونه عملکرد یک ابزار هوش مصنوعی مولد در آزمایشگاه به بیمارستانها و کلینیکهای سرپایی ترجمه میشود، و شاید مهمتر از آن، چگونگی روند نتایج در طول زمان بسیار دشوار است.

این بدان معنا نیست که Open Medical-LLM مفید یا آموزنده نیست. تابلوی امتیازات نتایج، اگر هیچ چیز دیگری نباشد، یادآور این است که مدلها چقدر ضعیف به سؤالات اساسی سلامت پاسخ میدهند. اما Open Medical-LLM، و هیچ معیار دیگری برای این موضوع، جایگزینی برای آزمایش های دنیای واقعی است که به دقت فکر شده است.

ارسال نظر