Opera به کاربران اجازه می دهد LLM ها را به صورت محلی دانلود و استفاده کنند

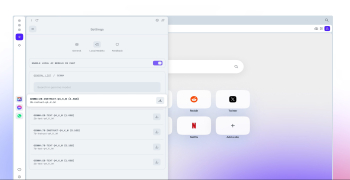

شرکت مرورگر وب Opera امروز اعلام کرد که اکنون به کاربران امکان می دهد مدل های زبان بزرگ (LLM) را به صورت محلی در رایانه خود دانلود و استفاده کنند. این ویژگی ابتدا در اختیار کاربران Opera One است که بهروزرسانیهای جریان توسعهدهنده را دریافت میکنند و به کاربران امکان میدهد از بین بیش از 150 مدل از بیش از 50 خانواده انتخاب کنند.

این مدل ها عبارتند از Llama از Meta، Gemma از Google و Vicuna. این ویژگی به عنوان بخشی از برنامه AI Feature Drops اپرا در دسترس کاربران قرار خواهد گرفت تا کاربران بتوانند زودتر به برخی از ویژگی های هوش مصنوعی دسترسی داشته باشند.

این شرکت بيان کرد که از چارچوب متن باز Ollama در مرورگر برای اجرای این مدل ها بر روی رایانه شما استفاده می کند. در حال حاضر تمامی مدل های موجود زیرمجموعه ای از کتابخانه Ollama هستند، اما در آینده این شرکت به دنبال گنجاندن مدل هایی از منابع مختلف است.

اعتبار تصویر: Opera

این شرکت اشاره کرد که هر نسخه بیش از 2 گیگابایت فضای سیستم محلی شما را اشغال می کند. پس باید مراقب فضای خالی خود باشید تا از تمام شدن فضای ذخیره سازی جلوگیری کنید. قابل ذکر است که اپرا هیچ کاری برای ذخیره فضای ذخیره سازی در حین دانلود یک مدل انجام نمی دهد.

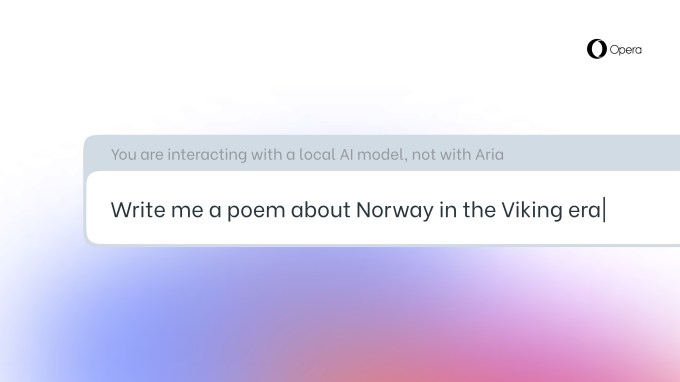

اپرا اکنون برای اولین بار دسترسی به مجموعه بزرگی از LLMهای محلی شخص ثالث را مستقیماً در مرورگر فراهم کرده است. پیش بینی می شود که اندازه آنها کاهش یابد زیرا آنها بیشتر و بیشتر برای کارهای مورد نظر تخصصی می شوند.

اعتبار تصویر: Opera

اگر قصد دارید مدل های مختلف را به صورت محلی آزمایش کنید، این ویژگی مفید است، اما اگر می خواهید در فضا صرفه جویی کنید، ابزارهای آنلاین زیادی مانند Quora's Poe و HuggingChat برای تحلیل مدل های مختلف وجود دارد.

اپرا از سال گذشته با ویژگی های مبتنی بر هوش مصنوعی بازی می کند. این شرکت در ماه می گذشته دستیاری به نام آریا در نوار کناری راه اندازی کرد و در ماه آگوست آن را به نسخه iOS معرفی کرد. در ژانویه، اپرا اعلام کرد که در حال ساخت یک مرورگر مبتنی بر هوش مصنوعی با موتور خود برای iOS است، زیرا قوانین بازار دیجیتال اتحادیه اروپا (DMA) از اپل خواسته است که الزامات موتور WebKit اجباری برای مرورگرهای تلفن همراه را کنار بگذارد.

ارسال نظر