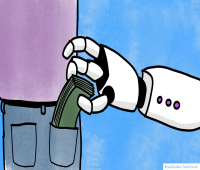

کلاهبرداری های مبتنی بر هوش مصنوعی و کارهایی که می توانید در مورد آنها انجام دهید

هوش مصنوعی اینجاست تا به شما کمک کند، خواه در حال تهیه پیش نویس ایمیل، ساختن برخی هنرهای مفهومی یا اجرای کلاهبرداری از افراد آسیب پذیر با ایجاد اینکه آنها را دوست یا خویشاوندی در مضطرب می پندارند. هوش مصنوعی بسیار همه کاره است! اما از آنجایی که برخی از افراد ترجیح می دهند مورد کلاهبرداری قرار نگیرند، بیایید کمی در مورد آنچه باید مراقب باشیم صحبت کنیم.

در چند سال اخیر نه تنها در کیفیت رسانه های تولید شده، از متن گرفته تا صدا گرفته تا تصویر و ویدئو، بلکه در میزان ارزان و آسانی نیز می توان آن رسانه تولید کرد. همان نوع ابزاری که به یک هنرمند مفهومی کمک میکند تا هیولاهای فانتزی یا سفینههای فضایی را بپزد یا به یک سخنران غیر بومی اجازه میدهد انگلیسی تجاری خود را بهبود بخشد، میتواند مورد استفاده مخرب نیز قرار گیرد.

انتظار نداشته باشید که ترمیناتور در خانه شما را بکوبد و شما را با یک طرح پونزی بفروشد - اینها همان کلاهبرداری های قدیمی هستند که ما سال ها با آن روبرو بودیم، اما با یک پیچش هوش مصنوعی مولد که آنها را آسان تر، ارزان تر یا قانع کننده تر می کند.

این به هیچ وجه یک فهرست کامل نیست، فقط تعدادی از بدیهی ترین ترفندهایی است که هوش مصنوعی می تواند به آنها اضافه کند. ما مطمئن خواهیم شد که اخبار را همانطور که در طبیعت ظاهر می شوند اضافه می کنیم، یا هر گام دیگری که می توانید برای محافظت از خود بردارید.

شبیه سازی صدای خانواده و دوستان

صداهای مصنوعی دهها سال است که وجود داشتهاند، اما تنها در یکی دو سال اخیر است که پیشرفتهای فناوری باعث شده صدای جدیدی از چند ثانیه صدا تولید شود. این بدان معناست که هر کسی که صدایش تا به حال به صورت عمومی پخش شده است - به عنوان مثال، در یک گزارش خبری، ویدیوی YouTube یا در رسانه های اجتماعی - در برابر شبیه سازی صدای خود آسیب پذیر است.

کلاهبرداران می توانند و از این فناوری برای تولید نسخه های جعلی متقاعد کننده از عزیزان یا دوستان خود استفاده کرده اند. البته اینها می توانند هر چیزی بگویند، اما در خدمت کلاهبرداری، به احتمال زیاد یک کلیپ صوتی برای درخواست کمک می سازند.

به عنوان مثال، والدین ممکن است از یک شماره ناشناس پیام صوتی دریافت کنند که شبیه پسرشان است، که او میگوید چگونه وسایلشان در سفر دزدیده شده است، شخصی به آنها اجازه استفاده از تلفن خود را میدهد و ممکن است مادر یا بابا مقداری پول به این آدرس، گیرنده Venmo ارسال کنند. ، تجارت و غیره. می توان به راحتی انواع مختلفی را با مشکل ماشین ("ماشین من را تا زمانی که کسی پول آنها را پرداخت نکند آزاد نمی کنند")، مسائل پزشکی ("این درمان تحت پوشش بیمه نیست") و غیره تصور کرد.

این نوع کلاهبرداری قبلاً با استفاده از صدای رئیس جمهور بایدن انجام شده است! آنها کسانی را که پشت آن بودند دستگیر کردند، اما کلاهبرداران آینده بیشتر مراقب خواهند بود.

چگونه می توانید با شبیه سازی صدا مقابله کنید؟

اول، سعی نکنید صدای جعلی را تشخیص دهید. آنها هر روز بهتر می شوند و راه های زیادی برای پنهان کردن مشکلات کیفی وجود دارد. حتی کارشناسان هم گول می خورند!

هر چیزی که از یک شماره، آدرس ایمیل یا حساب ناشناس باشد باید به طور خودکار مشکوک تلقی شود. اگر کسی او میگوید دوست یا عزیز شماست، ادامه دهید و همانطور که معمولاً با او تماس میگیرید، تماس بگیرید. آنها احتمالاً به شما خواهند بيان کرد که حالشان خوب است و این یک کلاهبرداری است (همانطور که حدس زدید).

کلاهبرداران تمایل دارند در صورت نادیده گرفته شدن آنها را پیگیری نکنند - در حالی که احتمالاً یکی از اعضای خانواده این کار را انجام می دهد. درست است که در حین بررسی، پیام مشکوکی را در زمان خواندن بگذارید.

فیشینگ و هرزنامه شخصی از طریق ایمیل و پیام

همه ما هرازگاهی هرزنامه دریافت می کنیم، اما هوش مصنوعی تولید متن امکان ارسال ایمیل انبوه سفارشی برای هر فرد را فراهم می کند. با نقض دادهها که به طور منظم اتفاق میافتد، بسیاری از دادههای شخصی شما در دسترس هستند.

این یک چیز است که یکی از این موارد را دریافت کنید "برای دیدن فاکتور خود اینجا را کلیک کنید!" ایمیلهای کلاهبرداری با پیوستهای آشکارا ترسناک که تلاش بسیار کم به نظر میرسند. اما حتی با کمی زمینه، ناگهان کاملاً باورپذیر میشوند و از مکانها، خریدها و عادتهای اخیر استفاده میکنند تا آن را مانند یک شخص واقعی یا یک مشکل واقعی جلوه دهند. با استفاده از چند حقایق شخصی، یک مدل زبانی میتواند در عرض چند ثانیه یک سری از این ایمیلها را برای هزاران گیرنده سفارشی کند.

پس آنچه زمانی "مشتری عزیز، لطفا فاکتور خود را پیوست شده پیدا کنید" بود، چیزی شبیه به "سلام دوریس! من با تیم تبلیغاتی Etsy هستم. کالایی که اخیراً به آن نگاه می کردید اکنون 50٪ تخفیف دارد! و اگر از این لینک برای درخواست تخفیف استفاده کنید، ارسال به آدرس شما در بلینگهام رایگان است. یک مثال ساده اما هنوز. با نام واقعی، عادت خرید (پیدا کردن آسان)، مکان عمومی (همچنین) و غیره، ناگهان پیام بسیار کمتر آشکار می شود.

در نهایت، اینها هنوز فقط اسپم هستند. اما این نوع هرزنامههای سفارشیشده زمانی باید توسط افرادی با حقوق ضعیف در مزارع محتوا در کشورهای خارجی انجام میشد. اکنون می توان آن را در مقیاس توسط یک LLM با مهارت های نثر بهتر از بسیاری از نویسندگان حرفه ای انجام داد!

چگونه می توانید با هرزنامه های ایمیل مقابله کنید؟

همانند هرزنامه های سنتی، هوشیاری بهترین سلاح شم است. اما انتظار نداشته باشید که بتوانید متن تولید شده را از متن نوشته شده توسط انسان در طبیعت متمایز کنید. تعداد کمی هستند که می توانند و مطمئناً (علی رغم ادعای برخی شرکت ها و خدمات) مدل دیگری از هوش مصنوعی را ندارند.

این نوع کلاهبرداری، هر چقدر که متن بهبود یافته باشد، همچنان چالش اساسی دارد که شما را وادار به باز کردن پیوستها یا پیوندهای طرحدار کند. مثل همیشه، تا زمانی که 100% از صحت و هویت فرستنده مطمئن نیستید، روی چیزی کلیک یا باز نکنید. اگر حتی کمی مطمئن نیستید - و این حس خوبی برای تزکیه کردن است - کلیک نکنید، و اگر فردی آگاه دارید که آن را برای یک جفت چشم دوم به او فوروارد کند، این کار را انجام دهید.

«شما جعلی» تقلب را شناسایی و تأیید می کند

با توجه به تعداد نقضهای داده در چند سال گذشته (با تشکر، Equifax!)، به جرات میتوان بيان کرد که تقریباً همه ما مقدار مناسبی از دادههای شخصی شناور در وب تاریک داریم. اگر از روشهای امنیتی آنلاین خوبی پیروی میکنید، بسیاری از خطرات کاهش مییابد زیرا رمزهای عبور خود را تغییر دادهاید، احراز هویت چند مرحلهای را فعال کردهاید و غیره. اما هوش مصنوعی مولد می تواند تهدیدی جدید و جدی در این زمینه باشد.

با وجود دادههای بسیار زیادی در مورد شخصی که به صورت آنلاین در دسترس است و برای بسیاری، حتی یک یا دو کلیپ از صدای آنها، به طور فزایندهای آسان است که یک شخصیت هوش مصنوعی ایجاد کنید که شبیه یک فرد هدف باشد و به بسیاری از حقایق مورد استفاده برای تأیید هویت دسترسی داشته باشد.

اینجوری درباره اش فکر کنید. اگر هنگام ورود با مشکل مواجه بودید، نمی توانستید برنامه احراز هویت خود را به درستی پیکربندی کنید، یا گوشی خود را گم کرده اید، چه کار می کنید؟ احتمالاً با خدمات مشتری تماس بگیرید - و آنها هویت شما را با استفاده از برخی حقایق بی اهمیت مانند تاریخ تولد، شماره تلفن یا شماره تامین اجتماعی "تأیید" می کنند. حتی روشهای پیشرفتهتری مانند «عکس سلفی» بازی کردن آسانتر میشود.

نماینده خدمات مشتری - برای همه ما می دانیم، همچنین یک AI! - ممکن است این جعلی شما را ملزم کند و تمام امتیازاتی را که اگر واقعاً تماس بگیرید به آن اعطا می کند. کارهایی که آنها از آن موقعیت می توانند انجام دهند بسیار متفاوت است، اما هیچ کدام خوب نیست!

مانند سایر موارد موجود در این فهرست ، خطر این است که این جعلی چقدر واقع بینانه باشد، بلکه این است که برای کلاهبرداران انجام این نوع حمله به طور گسترده و مکرر آسان است. چندی پیش، این نوع حمله جعل هویت گران و وقت گیر بود و در نتیجه به اهداف با ارزشی مانند افراد ثروتمند و مدیران عامل محدود می شد. امروزه میتوانید یک گردش کاری ایجاد کنید که هزاران نماینده جعل هویت را با حداقل نظارت ایجاد کند، و این نمایندگان میتوانند به طور مستقل شماره خدمات مشتری را در تمام حسابهای شناخته شده یک شخص تلفن کنند - یا حتی حسابهای جدیدی ایجاد کنند! فقط تعداد انگشت شماری نیاز به موفقیت دارند تا هزینه حمله را توجیه کنند.

چگونه می توانید با تقلب در هویت مقابله کنید؟

درست همانطور که قبل از اینکه هوش مصنوعی تلاش های کلاهبرداران را تقویت کند، "Sybersecurity 101" بهترین گزینه برای شم است. داده های شما در حال حاضر وجود دارد. شما نمی توانید خمیر دندان را دوباره در لوله قرار دهید. اما می توانید مطمئن شوید که حساب های شما به اندازه کافی در برابر واضح ترین حملات محافظت می شود.

احراز هویت چند عاملی به راحتی اصلی ترین قدمی است که هر کسی میتواند در اینجا بردارد. هر نوع فعالیت جدی حساب مستقیماً به تلفن شما می رود و ورودهای مشکوک یا تلاش برای تغییر رمز عبور در ایمیل ظاهر می شود. این هشدارها را نادیده نگیرید یا آنها را به عنوان هرزنامه علامت گذاری نکنید، حتی (به خصوص!) اگر زیاد دریافت می کنید.

دیپ فیک ها و باج گیری های تولید شده توسط هوش مصنوعی

شاید ترسناک ترین شکل کلاهبرداری با هوش مصنوعی، امکان باج گیری با استفاده از تصاویر عمیق جعلی از شما یا یکی از عزیزان باشد. شما می توانید از دنیای پر سرعت مدل های تصویر باز برای این چشم انداز آینده نگرانه و وحشتناک تشکر کنید! افرادی که به جنبه های خاصی از تولید تصاویر پیشرفته علاقه مند هستند، جریان های کاری را نه تنها برای رندر کردن بدن های برهنه، بلکه برای چسباندن آنها به هر چهره ای که می توانند از آن عکس بگیرند، ایجاد کرده اند. من نیازی به توضیح بیشتر در مورد نحوه استفاده از آن ندارم.

اما یکی از پیامدهای ناخواسته گسترش کلاهبرداری است که معمولاً «پورن انتقامی» نامیده میشود، اما بهطور دقیقتر به عنوان توزیع غیر توافقی تصاویر صمیمی توصیف میشود (اگرچه مانند «دیپفیک»، ممکن است جایگزینی عبارت اصلی دشوار باشد). هنگامی که تصاویر خصوصی شخصی یا از طریق هک یا یک سابق انتقام جو منتشر می شود، می تواند به عنوان باج گیری توسط شخص ثالثی که تهدید می کند آنها را به طور گسترده منتشر می کند، مگر اینکه مبلغی پرداخت شود، استفاده شود.

هوش مصنوعی این کلاهبرداری را با ایجاد آن افزایش می دهد تا در وهله اول نیازی به تصویرسازی واقعی وجود نداشته باشد! چهره هر کسی را میتوان به بدنی که با هوش مصنوعی تولید میکند اضافه کرد، و اگرچه نتایج همیشه قانعکننده نیستند، احتمالاً برای فریب دادن شما یا دیگران کافی است اگر دارای پیکسل، وضوح پایین یا تا حدی مبهم باشد. و این تمام چیزی است که برای ترساندن کسی از پرداخت هزینه برای مخفی نگه داشتن آنها لازم است - اگرچه، مانند اکثر کلاهبرداری های باج خواهی، بعید است که اولین پرداخت آخرین باشد.

چگونه می توانید با دیپ فیک های تولید شده توسط هوش مصنوعی مبارزه کنید؟

متأسفانه، جهانی که ما به سمت آن حرکت می کنیم، دنیایی است که در آن تصاویر برهنه جعلی تقریباً هر کسی در صورت تقاضا در دسترس خواهد بود. این ترسناک و عجیب و ناخوشایند است، اما متأسفانه گربه از کیف خارج شده است.

هیچ کس از این وضعیت راضی نیست به جز بچه های بد. اما چند چیز برای همه ما قربانیان احتمالی وجود دارد. ممکن است راحت باشد، اما این تصاویر واقعاً مربوط به شما نیستند و برای اثبات آن نیازی به عکس های برهنه واقعی نیست. این مدلهای تصویری ممکن است از برخی جهات بدن واقعی تولید کنند، اما مانند سایر هوش مصنوعی مولد، آنها فقط میدانند که در مورد چه چیزی آموزش دیدهاند. پس ، برای مثال، تصاویر جعلی فاقد هر گونه علامت متمایز هستند و احتمالاً از جهات دیگر اشتباه هستند.

و در حالی که این تهدید به احتمال زیاد هرگز به طور کامل کاهش نخواهد یافت، به طور فزاینده ای برای قربانیان مراجعه می شود، که می توانند از نظر قانونی میزبان های تصویر را مجبور به حذف عکس ها کنند یا کلاهبرداران را از سایت هایی که در آن پست می کنند ممنوع کنند. همانطور که مشکل رشد می کند، ابزار قانونی و خصوصی مبارزه با آن نیز افزایش می یابد.

TechCrunch یک وکیل نیست! اما اگر قربانی این موضوع هستید، به پلیس بگویید. این فقط یک کلاهبرداری نیست، بلکه آزار و اذیت است، و اگرچه نمیتوانید از پلیس انتظار داشته باشید که کارآگاهی عمیق اینترنتی مورد نیاز برای ردیابی شخصی را انجام دهند، این موارد گاهی اوقات حل میشوند، یا کلاهبرداران با درخواستهایی که به ISP ارسال میشوند ترسیده میشوند. میزبان انجمن

ارسال نظر